Parte 1: Fundamentos e a Dualidade da Performance

Introdução

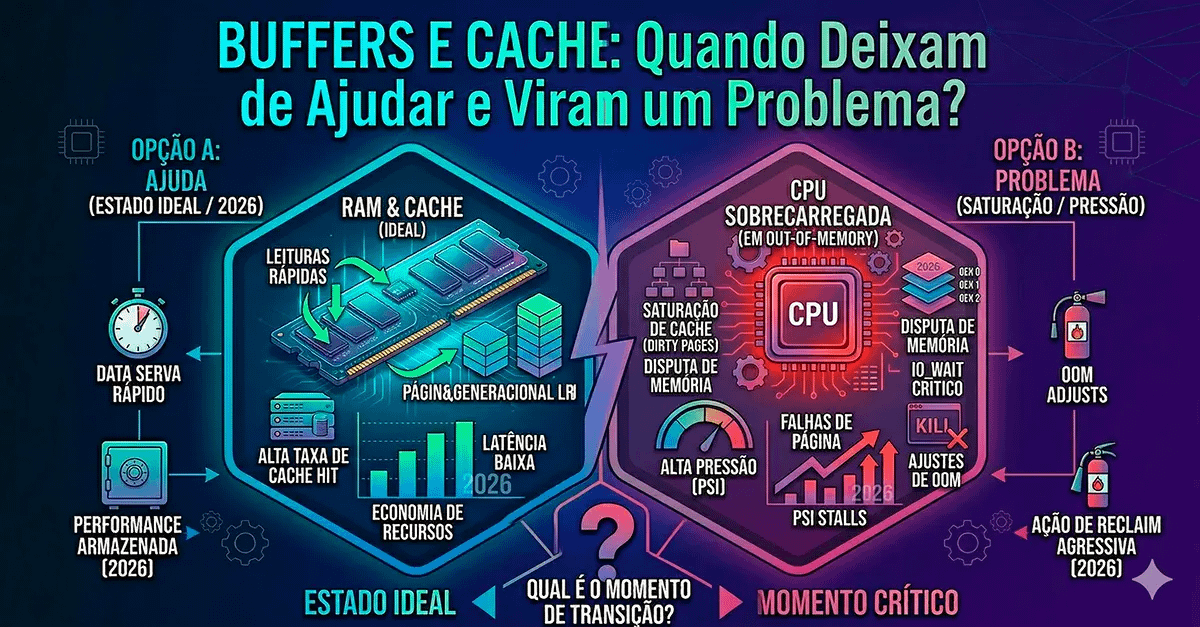

No universo da computação, a busca pela velocidade é implacável. Para mitigar o abismo de performance entre processadores ultrarrápidos e dispositivos de armazenamento mais lentos, surgiram duas soluções fundamentais: buffers e cache. No entanto, o que deveria ser a solução para a latência, muitas vezes se torna a causa de travamentos, erros de exibição e gargalos de rede.

Neste guia completo, exploraremos profundamente o funcionamento dessas tecnologias e, principalmente, identificaremos o ponto de inflexão onde o benefício se transforma em um “problema de verdade”.

O uso de buffers e cache no Linux é frequentemente mal interpretado. Para entender o comportamento completo da memória, veja o guia de performance de servidores Linux.

O que é Cache? (A Memória de Curto Prazo)

O cache é, essencialmente, uma camada de armazenamento de alta velocidade que guarda um subconjunto de dados, geralmente transitórios, para que solicitações futuras desses dados sejam atendidas de forma mais rápida do que seria possível acessando o local de armazenamento principal.

Imagine que você está lendo um livro em uma biblioteca. A prateleira é o seu HD (lento para buscar). A sua mesa, onde você deixa os 3 livros que mais consulta, é o seu cache. É muito mais rápido olhar para a mesa do que levantar e andar até a estante toda vez.

O que é Buffer? (O Regulador de Fluxo)

Diferente do cache, o buffer não foca necessariamente em “reutilização”, mas em “sincronização”. Ele atua como uma zona de espera temporária para dados que estão sendo transferidos entre dois locais que trabalham em velocidades diferentes.

O exemplo clássico é o streaming de vídeo. Sua internet pode oscilar, mas o buffer baixa alguns segundos à frente e os armazena. Assim, o player de vídeo consome esses dados de forma constante, sem interrupções, mesmo que a conexão caia por um milésimo de segundo.

A Anatomia do Problema: Quando o Excesso Prejudica

A gestão de buffers e cache é um jogo de equilíbrio. Um sistema com cache insuficiente é lento por natureza; um sistema com cache mal gerenciado é instável. O problema real surge em três frentes principais:

- Consumo excessivo de memória RAM.

- Inconsistência de dados (Cache Stale).

- Latência induzida por filas (Bufferbloat).

Buffers e cache fazem parte da otimização do sistema. Confira nosso guia de otimização de servidores Linux

Parte 2: Bufferbloat, Latência e o Gargalo de Hardware

O Fenômeno do Bufferbloat: Quando a Espera é Pior que a Perda

Um dos problemas mais silenciosos e destrutivos na rede mundial de computadores é o Bufferbloat. Para entender por que buffers e cache podem ser um problema aqui, precisamos analisar como os roteadores modernos lidam com o tráfego.

Originalmente, os buffers de rede foram projetados para evitar que pacotes de dados fossem descartados em caso de pequenos picos de tráfego. No entanto, com a memória RAM tornando-se barata, os fabricantes de hardware começaram a inserir buffers gigantescos. O resultado? Em vez de o pacote ser descartado (o que avisaria ao protocolo TCP para “diminuir a velocidade”), o pacote fica parado em uma fila imensa dentro do roteador.

Isso gera uma latência artificial. Você tem uma conexão de 500 Mbps, mas seu jogo online trava ou sua chamada de vídeo congela. Isso acontece porque os buffers e cache de pacotes estão sobrecarregados, priorizando a quantidade de dados em vez da velocidade de entrega. Para o usuário final, isso é um “problema de verdade” que muitas vezes é diagnosticado erroneamente como “internet lenta”, quando na verdade é “internet mal gerenciada”.

Invalidação de Cache: O Maior Pesadelo dos Programadores

Existe uma frase famosa na computação: “Só existem duas coisas difíceis na Ciência da Computação: invalidação de cache e dar nome às coisas”. A invalidação ocorre quando o sistema decide que o dado guardado no cache não é mais confiável e precisa ser descartado.

Quando a política de invalidação falha, entramos no terreno dos dados obsoletos (stale data). Imagine um sistema de e-commerce onde o preço de um produto foi atualizado na base de dados principal, mas o cache do navegador ou do servidor de borda (CDN) ainda exibe o preço antigo. Isso não é apenas um bug visual; é um problema jurídico e financeiro.

O problema de verdade aqui é a consistência. Manter a sincronia entre o armazenamento rápido e o armazenamento persistente exige algoritmos complexos. Se o cache for agressivo demais, o usuário vê erros. Se for conservador demais, o servidor sofre um “cache miss”, onde cada requisição vai direto para o banco de dados, podendo levar o site à queda por excesso de carga.

Em alguns casos, o comportamento da memória pode indicar gargalos. Veja a estratégia de otimização de servidores Linux.

A Degradação do Hardware e o Desgaste da Memória

Outro ponto raramente discutido é o impacto físico de buffers e cache em dispositivos de armazenamento, como SSDs. O uso intensivo de buffers de escrita pode, em cenários específicos de falha de energia, levar à corrupção de dados se o dispositivo não possuir proteção contra perda de energia (PLP).

Além disso, sistemas que fazem cache excessivo em disco (swap ou arquivos temporários) em vez de usar a memória RAM podem acelerar o desgaste das células flash do SSD. Quando o cache deixa de ser uma otimização lógica e passa a ser uma muleta para a falta de memória RAM física, ele se torna um problema de hardware a longo prazo. O sistema começa a “esgoelar” o processador enquanto tenta gerenciar arquivos temporários imensos, criando o que chamamos de thrashing de disco.

Parte 3: O Gargalo no Navegador e o Impacto no Desenvolvimento Web

O Cache do Lado do Cliente: Velocidade vs. Atualização

No desenvolvimento web, o uso de buffers e cache é a espinha dorsal de uma experiência fluida. Quando você visita um site pela segunda vez e ele carrega instantaneamente, é o cache do navegador fazendo o seu trabalho. Ele armazena localmente arquivos pesados, como imagens de alta resolução, scripts JavaScript e folhas de estilo (CSS).

No entanto, o problema de verdade surge com a persistência indesejada. Se um desenvolvedor lança uma correção crítica em um script, mas o navegador do usuário decide que o cache ainda é válido por mais sete dias, o usuário continuará enfrentando o erro, mesmo que o servidor já tenha a solução. Isso gera chamados de suporte desnecessários e frustração. Técnicas como Cache Busting (adicionar uma versão ou hash ao nome do arquivo) são necessárias para “forçar” o sistema a entender que o equilíbrio de buffers e cache mudou.

O uso de memória deve ser interpretado corretamente para evitar decisões erradas. Veja também:

Service Workers e o Cache PWA

Com a ascensão dos Progressive Web Apps (PWAs), o gerenciamento de buffers e cache subiu de nível. Através de Service Workers, o desenvolvedor pode programar estratégias complexas, como:

- Stale-while-revalidate: Entrega o cache primeiro (rápido) e atualiza em segundo plano.

- Cache-first: Ideal para ativos estáticos.

- Network-first: Prioriza o dado novo, usando o cache apenas como backup (fallback).

Onde está o problema aqui? No esgotamento de cota. Dispositivos móveis têm limites rígidos de armazenamento para navegadores. Se o seu web app armazena cache de forma descuidada, o sistema operacional do celular pode deletar todos os dados do seu site sem aviso prévio para liberar espaço, resultando em perda de dados offline do usuário.

Buffering de Mídia e a Percepção de Qualidade

Quando falamos em vídeo e áudio, o buffer é o único herói que impede o temido ícone de carregamento girando no meio da tela. O processo de buffering consiste em pré-carregar segmentos do vídeo em uma área de memória reservada.

O “problema de verdade” ocorre na alocação dinâmica. Se o algoritmo de buffering for agressivo demais, ele consome toda a largura de banda do usuário para baixar partes do vídeo que ele talvez nem assista (caso ele feche a aba), desperdiçando dados (especialmente em conexões móveis pagas). Se for muito conservador, qualquer oscilação mínima na rede causará interrupções. O desafio técnico é criar buffers adaptativos que entendam a latência da rede em tempo real.

Vazamentos de Memória em Aplicações de Longa Duração

Aplicações modernas (como painéis de monitoramento ou abas do Gmail que ficam abertas por dias) sofrem muito com o acúmulo de buffers e cache. Se o JavaScript do site continua criando buffers para processar dados de entrada e não os libera corretamente (através do Garbage Collector), o consumo de RAM sobe de 200MB para 4GB em poucas horas.

Isso torna o navegador pesado, fazendo com que todo o sistema operacional sofra. Aqui, o cache deixa de ser uma técnica de otimização e passa a ser um vazamento de recursos, tornando o dispositivo do usuário final lento e instável.

Interpretar corretamente a memória é essencial. Veja como melhorar a performance do servidor Linux.

Parte 4: Sistemas Operacionais e o Veredito de Performance

O Kernel e a Ilusão da Memória RAM Cheia

Um dos pontos que mais causa confusão entre usuários de Windows, Linux e macOS é o gerenciamento de memória feito pelo Kernel. Frequentemente, ao abrir um monitor de sistema, o usuário vê que quase toda a sua RAM está “em uso”. No entanto, uma grande fatia dessa memória está alocada como Page Cache.

O sistema operacional utiliza a RAM ociosa para fazer buffers e cache dos arquivos acessados no disco rígido ou SSD. Como a RAM é ordens de magnitude mais rápida que qualquer SSD, o Kernel mantém cópias de arquivos lidos recentemente ali.

- O problema de verdade: Só ocorre quando um aplicativo de alta prioridade precisa de memória real e o Kernel falha em “limpar” o cache rapidamente, causando um pequeno congelamento (stuttering). Na maioria das vezes, porém, “RAM livre é RAM desperdiçada”.

Cache de Escrita e o Risco de Corrupção

Os sistemas de arquivos modernos utilizam buffers de escrita para otimizar o desempenho. Quando você move um arquivo para um pendrive, o sistema operacional diz que a tarefa terminou em 2 segundos. Na verdade, os dados ainda estão sendo gravados fisicamente a partir de um buffer na memória.

O “problema de verdade” aqui é a volatilidade. Se você remover o dispositivo sem “ejetar com segurança” ou se houver uma queda de energia, os dados que estavam no buffer mas não chegaram ao disco serão perdidos ou corrompidos. É um exemplo clássico onde a busca por velocidade (através do buffer) compromete a integridade se não houver um protocolo rigoroso de fechamento.

Quando Limpar o Cache é a Decisão Errada?

Existe um mito persistente de que softwares de “limpeza de sistema” que esvaziam buffers e cache constantemente tornam o computador mais rápido. Na prática, isso costuma causar o efeito oposto.

Ao limpar o cache de forma agressiva, você força o processador a trabalhar dobrado para recarregar informações que já estavam prontas. O “Cold Start” (inicialização a frio) de aplicativos após uma limpeza profunda consome mais energia e ciclos de CPU. O problema real não é a existência do cache, mas sim a sua fragmentação ou quando ele contém dados corrompidos que impedem a execução de um binário.

Conclusão: O Veredito Técnico

Afinal, quando buffers e cache são um problema de verdade? A resposta reside na visibilidade e no controle. Eles se tornam vilões quando:

- Ocultam falhas de conexão: O bufferbloat esconde uma rede instável sob uma camada de latência insuportável.

- Entregam mentiras: O cache obsoleto faz o usuário tomar decisões baseadas em dados que já mudaram.

- Causam Inanição (Starvation): Quando o cache consome recursos de memória que outros processos essenciais precisam para sobreviver.

Para desenvolvedores e administradores de sistemas, a chave não é evitar essas tecnologias, mas implementar políticas de expiração inteligentes (TTL – Time to Live) e garantir que o tamanho dos buffers seja proporcional à velocidade real do barramento de dados. No fim das contas, o cache deve ser um acelerador, nunca uma máscara para uma arquitetura ineficiente.

Para evitar decisões erradas, é essencial entender o sistema como um todo. Consulte o guia de como otimizar servidores Linux.

FAQ

Curto prazo, sim, se estiver corrompido. Longo prazo, não, pois o sistema terá que recriar os arquivos, o que consome mais processamento inicialmente.

O Buffer é uma área de armazenamento temporário para dados em movimento (fluxo), enquanto o Cache armazena dados acessados frequentemente para acelerar consultas futuras.

Acontece quando o cache não é invalidado após uma alteração no dado original, entregando uma versão antiga ao usuário.

Embora tecnicamente possível em alguns sistemas operacionais e navegadores, desativar buffers e cache resultaria em uma degradação drástica de performance. O processador ficaria ocioso aguardando a leitura lenta dos discos rígidos ou da rede, e a navegação na web seria interrompida por constantes travamentos de carregamento. Essas tecnologias são essenciais para “mascarar” a lentidão do hardware de armazenamento.

Sim. Os caches L1, L2 e L3 são físicos, localizados dentro do processador (hardware), e servem para acelerar a execução de instruções. O que discutimos no artigo é o cache de software (navegadores, sites e sistemas operacionais), que lida com arquivos e dados de alto nível. Ambos seguem o mesmo princípio: aproximar o dado do processador para ganhar tempo.

O Thrashing ocorre quando o sistema gasta mais tempo movendo dados entre os buffers e cache e a memória principal do que realmente processando informações. É como uma biblioteca onde o bibliotecário corre tanto para organizar os livros na mesa que não sobra tempo para ninguém ler. Isso geralmente indica falta de memória RAM física.

Veja Mais:

Performance de Servidores Linux: Guia Completo 2026

Swap Alto com RAM Livre: Por Que Isso Acontece e como Resolver

Servidor Lento: Como Identificar o Gargalo

I/O de disco servidor Linux: Como Resolver Gargalos

CPU 100% no Linux: O Que Verificar Primeiro no Servidor

Como Usar vmstat para Achar Gargalo no Linux em Minutos

Load Average no Linux: Como Interpretar Corretamente

Como Achar Gargalo com Iostat: Guia Definitivo e Prático

Iowait Alto: Causas Reais e Soluções

Guia Completo de Monitoramento Linux com vmstat, iostat e sar

Tuning de sysctl para Produção: Guia Definitivo de Performance Linux

OOM Killer e MySQL: Como Evitar que o Linux Mate seu Banco de Dados

Como Ajustar limits.conf no Linux: Guia para Alta Performance

Memory Leak Linux: Como Detectar e Corrigir

No space left on device com espaço livre? Como resolver (Guia Completo)

Como identificar processo que consome CPU no Linux (Guia Completo)

Como Limitar CPU por Processo no Linux com cgroups (Guia Completo)

Upgrade de CPU ou Otimizar? Guia Completo

RAM Cheia no Linux: O Guia Definitivo para Resolver Travamentos em 2026

Disco Lento no Linux: Guia Completo para Identificar e Resolver

Latência de Disco no Linux Alta: Causas, Diagnóstico e Soluções